Multi-Tenancy-Architekturmuster: Ueber die Grundlagen hinaus

Fortgeschrittene Multi-Tenant-Architekturmuster fuer SaaS-Plattformen — von Datenisolationsstrategien bis hin zu Tenant-spezifischer Anpassung und Skalierung.

Die meisten Multi-Tenancy-Anleitungen hoeren bei "fuege eine tenant_id-Spalte hinzu und filtere deine Queries" auf. Das bringt Sie durch die ersten Monate. Dann beginnt ein Tenant mit 10x den Daten die Performance fuer alle anderen zu verschlechtern, ein Enterprise-Interessent fragt nach White-Labeling und ein Partner will seinen eigenen Zahlungsdienstleister integrieren. Ploetzlich reichen die Grundlagen nicht mehr.

Dieser Beitrag behandelt die Muster, die ich in produktiven Multi-Tenant-Systemen implementiert habe, die ueber Query-Scoping hinausgehen. Das sind die architektonischen Entscheidungen, die einen Prototyp von einer Plattform unterscheiden.

Fortgeschrittene Isolationsmuster

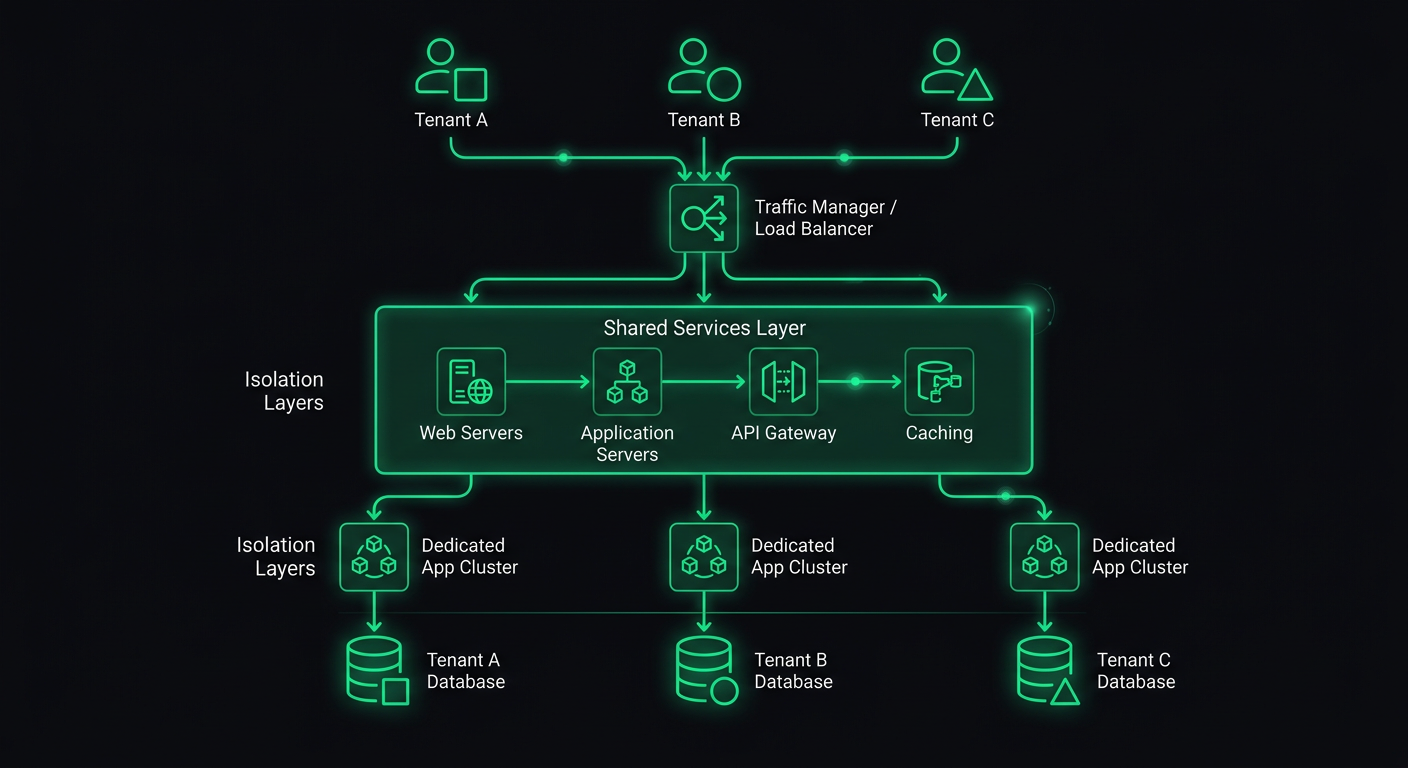

Das Drei-Stufen-Modell aus gemeinsamer Datenbank, Schema-pro-Tenant und Datenbank-pro-Tenant ist gut verstanden. Weniger diskutiert wird der hybride Ansatz, den die meisten Produktionssysteme tatsaechlich am Ende verwenden.

Gestaffelte Isolation nach Kundensegment

In der Praxis waehlen Sie selten eine Isolationsebene und wenden sie einheitlich an. Stattdessen staffeln Sie Ihre Isolation basierend darauf, was jedes Kundensegment braucht und bereit ist zu zahlen.

interface TenantConfig {

id: string;

slug: string;

isolationLevel: "shared" | "schema" | "dedicated";

databaseUrl?: string; // only for dedicated tenants

schemaName?: string; // only for schema-isolated tenants

}

function getConnectionForTenant(tenant: TenantConfig) {

switch (tenant.isolationLevel) {

case "shared":

return getSharedPool();

case "schema":

return getSchemaConnection(tenant.schemaName!);

case "dedicated":

return getDedicatedConnection(tenant.databaseUrl!);

}

}

Die Shared-Stufe bedient Ihre Self-Serve-Kunden. Schema-Isolation bedient Mid-Market-Kunden, die Compliance-Dokumentation benoetigen. Dedizierte Datenbanken bedienen Enterprise-Konten, die physische Datentrennung erfordern.

Die zentrale Designbedingung: Ihr Anwendungscode sollte weder wissen noch sich darum kuemmern, auf welcher Stufe ein Tenant ist. Die Verbindungsaufloesung geschieht in der Middleware, und alles Nachgelagerte verwendet das gleiche Query-Interface. Wenn ein Route-Handler die Isolationsebene pruefen muss, um zu entscheiden, wie Daten abgefragt werden, leckt Ihre Abstraktion.

Row-Level Security als Sicherheitsnetz

PostgreSQLs Row-Level Security ist das am meisten unterschaetzte Feature in Multi-Tenant-Architekturen. Selbst mit diszipliniertem Query-Scoping in Ihrer Anwendungsschicht bietet RLS eine Garantie auf Datenbankebene, dass ein Tenant nicht auf die Daten eines anderen Tenants zugreifen kann.

ALTER TABLE orders ENABLE ROW LEVEL SECURITY;

CREATE POLICY tenant_isolation ON orders

USING (tenant_id = current_setting('app.current_tenant')::uuid);

ALTER TABLE orders FORCE ROW LEVEL SECURITY;

Auf Verbindungsebene setzen Sie den Tenant-Kontext, bevor Queries ausgefuehrt werden:

async function withTenantContext<T>(

tenantId: string,

callback: (client: PoolClient) => Promise<T>

): Promise<T> {

const client = await pool.connect();

try {

await client.query("SET app.current_tenant = $1", [tenantId]);

return await callback(client);

} finally {

await client.query("RESET app.current_tenant");

client.release();

}

}

Damit wird, selbst wenn Ihr Anwendungscode einen Bug hat, der die WHERE tenant_id = ?-Klausel auslasst, die Datenbank selbst die Ergebnisse filtern. Das hat in der Produktion bei mir echte Bugs gefangen. Ein Entwickler schrieb eine Reporting-Query, die ueber Tabellen jointe und den Tenant-Filter bei einer vergass — RLS gab stillschweigend nur die korrekten Zeilen zurueck, anstatt Daten zu leaken.

Das FORCE ROW LEVEL SECURITY ist wichtig. Ohne es umgehen Tabelleneigentuemer (typischerweise die Rolle, die Ihre Anwendung verwendet) die RLS-Policies. Mit ihm gelten die Policies fuer alle.

Tenant-bewusste Middleware-Pipeline

Die Tenant-Aufloesung-Middleware, die ich in meinem vorherigen Beitrag ueber Multi-Tenant-Backends behandelt habe, uebernimmt die Grundlagen: Tenant aus Subdomain oder JWT extrahieren, an den Request anhaengen. Aber ein Produktionssystem braucht eine reichhaltigere Middleware-Pipeline, die einen vollstaendigen Tenant-Kontext aufbaut.

interface TenantContext {

id: string;

slug: string;

config: TenantConfig;

plan: PlanTier;

features: Set<string>;

limits: TenantLimits;

branding?: TenantBranding;

}

async function buildTenantContext(tenantId: string): Promise<TenantContext> {

// Cache this aggressively — it's read on every request

const cacheKey = `tenant:${tenantId}:context`;

const cached = await redis.get(cacheKey);

if (cached) return JSON.parse(cached);

const [tenant, plan, features, limits, branding] = await Promise.all([

db("tenants").where({ id: tenantId }).first(),

db("tenant_plans").where({ tenant_id: tenantId, active: true }).first(),

db("tenant_features").where({ tenant_id: tenantId, enabled: true }).select("feature_key"),

db("tenant_limits").where({ tenant_id: tenantId }).first(),

db("tenant_branding").where({ tenant_id: tenantId }).first(),

]);

const context: TenantContext = {

id: tenant.id,

slug: tenant.slug,

config: tenant.config,

plan: plan.tier,

features: new Set(features.map((f) => f.feature_key)),

limits: limits ?? DEFAULT_LIMITS,

branding: branding ?? undefined,

};

await redis.set(cacheKey, JSON.stringify(context), "EX", 300);

return context;

}

Die Middleware haengt dann diesen vollstaendigen Kontext an den Request an:

export async function tenantContextMiddleware(

req: Request,

res: Response,

next: NextFunction

) {

if (!req.tenantId) return next();

try {

req.tenantContext = await buildTenantContext(req.tenantId);

// Check if tenant is active

if (req.tenantContext.config.status === "suspended") {

return res.status(403).json({

error: "Account suspended",

reason: req.tenantContext.config.suspensionReason,

});

}

next();

} catch (error) {

next(error);

}

}

Jeder nachgelagerte Handler hat jetzt Zugriff auf den vollstaendigen Tenant-Kontext, ohne zusaetzliche Datenbankabfragen zu machen. Der Fuenf-Minuten-Cache bedeutet, dass eine Plan-Aenderung schnell propagiert, aber Sie nicht bei jeder Anfrage die Datenbank abfragen, um zu pruefen, ob ein Feature aktiviert ist.

Dynamische Konfiguration pro Tenant

Ueber Feature Flags hinaus brauchen Tenants oft konfigurierbares Verhalten. Eine Restaurantplattform koennte jedem Restaurant erlauben, eigene Bestellschlusszeiten, Steuersaetze, Lieferzonen und Benachrichtigungseinstellungen festzulegen. Ein Projektmanagement-Tool koennte jedem Workspace erlauben, benutzerdefinierte Felder, Workflow-Stufen und Benachrichtigungsregeln zu konfigurieren.

Das Muster, das ich verwende, trennt die Konfiguration in eine schemavalidierte JSON-Spalte:

import { z } from "zod";

const TenantSettingsSchema = z.object({

timezone: z.string().default("UTC"),

locale: z.string().default("en"),

currency: z.string().default("USD"),

notifications: z.object({

emailDigest: z.enum(["daily", "weekly", "never"]).default("daily"),

slackWebhook: z.string().url().optional(),

webhookUrl: z.string().url().optional(),

}).default({}),

limits: z.object({

maxUsersOverride: z.number().optional(),

maxStorageMbOverride: z.number().optional(),

apiRateLimitOverride: z.number().optional(),

}).default({}),

customFields: z.array(z.object({

key: z.string(),

label: z.string(),

type: z.enum(["text", "number", "date", "select"]),

options: z.array(z.string()).optional(),

required: z.boolean().default(false),

})).default([]),

});

type TenantSettings = z.infer<typeof TenantSettingsSchema>;

Die Einstellungen werden als JSONB in PostgreSQL gespeichert, was Ihnen Indexierungs- und Abfragemoeglichkeiten bietet und gleichzeitig das Schema flexibel haelt:

async function getTenantSettings(tenantId: string): Promise<TenantSettings> {

const row = await db("tenant_settings")

.where({ tenant_id: tenantId })

.first();

return TenantSettingsSchema.parse(row?.settings ?? {});

}

async function updateTenantSettings(

tenantId: string,

updates: Partial<TenantSettings>

): Promise<TenantSettings> {

const current = await getTenantSettings(tenantId);

const merged = { ...current, ...updates };

const validated = TenantSettingsSchema.parse(merged);

await db("tenant_settings")

.insert({

tenant_id: tenantId,

settings: validated,

updated_at: new Date(),

})

.onConflict("tenant_id")

.merge();

// Invalidate cache

await redis.del(`tenant:${tenantId}:context`);

return validated;

}

Das Zod-Schema dient doppeltem Zweck: Es validiert Einstellungen beim Schreiben und stellt Standardwerte beim Lesen bereit. Wenn Sie eine neue Einstellung hinzufuegen, erhalten bestehende Tenants automatisch den Standardwert ohne eine Datenmigration.

Feature Flags pro Tenant

Einfache boolesche Flags reichen fuer eine ausgereifte Plattform nicht aus. Sie brauchen Unterstuetzung fuer prozentuale Rollouts, planbasiertes Gating und pro-Tenant-Overrides.

interface FeatureFlag {

key: string;

defaultEnabled: boolean;

rolloutPercentage: number; // 0-100

planMinimum?: PlanTier;

tenantOverrides: Map<string, boolean>; // explicit per-tenant overrides

}

class FeatureFlagService {

private flags: Map<string, FeatureFlag>;

constructor(private cache: CacheStore) {

this.flags = new Map();

}

async isEnabled(tenantId: string, featureKey: string): Promise<boolean> {

const flag = await this.getFlag(featureKey);

if (!flag) return false;

// Explicit per-tenant override takes precedence

if (flag.tenantOverrides.has(tenantId)) {

return flag.tenantOverrides.get(tenantId)!;

}

// Plan-based gating

if (flag.planMinimum) {

const tenantPlan = await this.getTenantPlan(tenantId);

if (planRank(tenantPlan) < planRank(flag.planMinimum)) {

return false;

}

}

// Percentage rollout — deterministic based on tenant ID

if (flag.rolloutPercentage < 100) {

const hash = this.hashTenantFeature(tenantId, featureKey);

return hash % 100 < flag.rolloutPercentage;

}

return flag.defaultEnabled;

}

private hashTenantFeature(tenantId: string, featureKey: string): number {

const str = `${tenantId}:${featureKey}`;

let hash = 0;

for (let i = 0; i < str.length; i++) {

hash = ((hash << 5) - hash + str.charCodeAt(i)) | 0;

}

return Math.abs(hash);

}

}

Der deterministische Hash ist wichtig fuer Rollouts. Ein Tenant sieht das Feature entweder konsistent oder nicht — Sie wollen nicht, dass er es bei einer Anfrage sieht und bei der naechsten nicht. Der Hash wird aus der Tenant-ID und dem Feature-Key berechnet, sodass verschiedene Features an verschiedene Teilmengen von Tenants ausgerollt werden koennen.

In Route-Handlern ist die Pruefung sauber:

app.get("/api/v2/analytics", async (req, res) => {

const useNewAnalytics = await featureFlags.isEnabled(

req.tenantId,

"analytics_v2"

);

if (useNewAnalytics) {

return res.json(await analyticsV2.getDashboard(req.tenantId));

}

return res.json(await analyticsV1.getDashboard(req.tenantId));

});

Tenant-spezifische Integrationen

Enterprise-Tenants werden ihre eigenen Tools verbinden wollen: ihr eigenes Stripe-Konto fuer die Zahlungsabwicklung, ihr eigenes SendGrid-Konto fuer E-Mails, ihren eigenen S3-Bucket fuer Dateispeicherung. Ihre Plattform muss das unterstuetzen, ohne zu einem Konfigurationsalptraum zu werden.

Das Muster ist eine Integrationsregistry, die die richtigen Credentials pro Tenant aufloeist:

interface IntegrationConfig {

provider: string;

credentials: Record<string, string>; // encrypted at rest

settings: Record<string, unknown>;

isCustom: boolean; // true = tenant's own account, false = platform default

}

class IntegrationRegistry {

async getIntegration(

tenantId: string,

integrationType: "email" | "payment" | "storage" | "sms"

): Promise<IntegrationConfig> {

// Check for tenant-specific integration first

const custom = await db("tenant_integrations")

.where({ tenant_id: tenantId, type: integrationType, active: true })

.first();

if (custom) {

return {

provider: custom.provider,

credentials: await decrypt(custom.encrypted_credentials),

settings: custom.settings,

isCustom: true,

};

}

// Fall back to platform defaults

return this.getPlatformDefault(integrationType);

}

}

Die Service-Schicht verwendet dann die Registry, um den richtigen Client zu erhalten:

class EmailService {

constructor(private integrations: IntegrationRegistry) {}

async sendEmail(tenantId: string, email: EmailPayload): Promise<void> {

const config = await this.integrations.getIntegration(tenantId, "email");

const client = this.createClient(config);

await client.send({

from: config.settings.fromAddress as string,

...email,

});

}

private createClient(config: IntegrationConfig): EmailClient {

switch (config.provider) {

case "sendgrid":

return new SendGridClient(config.credentials.apiKey);

case "ses":

return new SESClient(config.credentials);

case "resend":

return new ResendClient(config.credentials.apiKey);

default:

throw new Error(`Unknown email provider: ${config.provider}`);

}

}

}

Das bedeutet, ein Tenant kann das gemeinsame SendGrid-Konto der Plattform nutzen, waehrend ein anderer seine eigene Amazon SES-Instanz mit eigener Domain und Reputation verwendet. Der Rest Ihres Anwendungscodes weiss oder kuemmert sich nicht — er ruft emailService.sendEmail() auf und die Integrationsschicht uebernimmt das Routing.

Credential-Sicherheit ist hier nicht verhandelbar. Vom Tenant bereitgestellte API-Keys muessen im Ruhezustand verschluesselt werden, vorzugsweise mit pro-Tenant-Verschluesselungsschluesseln. Verwenden Sie etwas wie AWS KMS oder HashiCorp Vault dafuer — entwickeln Sie kein eigenes Verschluesselungs-Key-Management.

Datenmigration zwischen Isolationsebenen

Eine der kniffligsten operativen Herausforderungen in Multi-Tenant-Systemen ist die Migration eines Tenants von einer Isolationsebene zu einer anderen. Ein wachsender Tenant koennte von gemeinsamen Tabellen zu seinem eigenen Schema wechseln. Ein Enterprise-Deal koennte die Migration eines Tenants zu einer dedizierten Datenbank erfordern.

Die Migration muss ohne Ausfallzeit erfolgen, was bedeutet, dass Sie nicht einfach dumpen und wiederherstellen koennen. Hier ist das Muster, das ich verwende:

interface TenantMigration {

tenantId: string;

fromLevel: IsolationLevel;

toLevel: IsolationLevel;

status: "pending" | "syncing" | "verifying" | "cutover" | "complete" | "failed";

startedAt: Date;

completedAt?: Date;

}

class TenantMigrator {

async migrateToSchema(tenantId: string): Promise<void> {

const migration = await this.createMigration(tenantId, "shared", "schema");

try {

// 1. Create the target schema with all tables

await this.createSchema(tenantId);

await this.updateStatus(migration, "syncing");

// 2. Copy existing data to the new schema

await this.copyData(tenantId, "public", `tenant_${tenantId}`);

// 3. Set up Change Data Capture to sync ongoing writes

const cdcStream = await this.startCDC(tenantId, "public", `tenant_${tenantId}`);

// 4. Verify data consistency

await this.updateStatus(migration, "verifying");

const isConsistent = await this.verifyConsistency(tenantId);

if (!isConsistent) throw new Error("Data consistency check failed");

// 5. Cutover: update tenant config to point to new schema

await this.updateStatus(migration, "cutover");

await db("tenants").where({ id: tenantId }).update({

isolation_level: "schema",

schema_name: `tenant_${tenantId}`,

});

// 6. Invalidate caches

await redis.del(`tenant:${tenantId}:context`);

// 7. Stop CDC and clean up source data

await cdcStream.stop();

await this.cleanupSourceData(tenantId, "public");

await this.updateStatus(migration, "complete");

} catch (error) {

await this.updateStatus(migration, "failed");

await this.rollback(migration);

throw error;

}

}

}

Der Change Data Capture-Schritt ist entscheidend. Zwischen dem Kopieren der Initialdaten und dem Cutover geschehen neue Schreibvorgaenge gegen die gemeinsamen Tabellen. CDC erfasst diese Schreibvorgaenge und spielt sie in das neue Schema ein, damit nichts verloren geht.

In der Praxis verwende ich dafuer PostgreSQL Logical Replication. Sie erstellen eine Publication auf den Quelltabellen, gefiltert nach tenant_id, und eine Subscription auf dem Zielschema. Sobald der Replikations-Lag nahe null ist, fuehren Sie den Cutover durch.

Der Rollback-Pfad ist gleich wichtig. Wenn waehrend der Migration etwas fehlschlaegt, muessen Sie alles sauber rueckgaengig machen koennen. Das bedeutet, die Quelldaten intakt zu lassen, bis die Migration verifiziert ist und der Tenant eine Vertrauensperiode lang auf dem neuen Schema operiert hat (ich warte typischerweise 48 Stunden, bevor ich Quelldaten bereinige).

Pro-Tenant-Monitoring und Observability

In einem Multi-Tenant-System ist "die API ist langsam" nicht handlungsfaehig. Sie muessen wissen, welcher Tenant betroffen ist, welche Queries langsam sind und ob das Problem tenant-spezifisch (Noisy Neighbor, grosse Datenmenge) oder plattformweit ist.

import { metrics } from "./lib/metrics"; // Prometheus, Datadog, etc.

function tenantMetricsMiddleware(req: Request, res: Response, next: NextFunction) {

const start = Date.now();

res.on("finish", () => {

const duration = Date.now() - start;

const labels = {

tenant_id: req.tenantId,

method: req.method,

route: req.route?.path ?? "unknown",

status: String(res.statusCode),

};

metrics.histogram("http_request_duration_ms", duration, labels);

metrics.counter("http_requests_total", 1, labels);

// Alert on tenant-specific degradation

if (duration > 2000) {

metrics.counter("http_slow_requests_total", 1, labels);

}

});

next();

}

Ueber Request-Level-Metriken hinaus verfolgen Sie den Ressourcenverbrauch pro Tenant:

interface TenantUsageMetrics {

tenantId: string;

period: string; // "2026-03"

apiCalls: number;

storageBytes: number;

bandwidthBytes: number;

computeMs: number;

activeUsers: number;

}

class UsageTracker {

async recordAPICall(tenantId: string, durationMs: number): Promise<void> {

const period = this.getCurrentPeriod();

await redis.hincrby(`usage:${tenantId}:${period}`, "apiCalls", 1);

await redis.hincrby(`usage:${tenantId}:${period}`, "computeMs", durationMs);

}

async getUsage(tenantId: string, period: string): Promise<TenantUsageMetrics> {

const data = await redis.hgetall(`usage:${tenantId}:${period}`);

return {

tenantId,

period,

apiCalls: parseInt(data.apiCalls ?? "0"),

storageBytes: parseInt(data.storageBytes ?? "0"),

bandwidthBytes: parseInt(data.bandwidthBytes ?? "0"),

computeMs: parseInt(data.computeMs ?? "0"),

activeUsers: parseInt(data.activeUsers ?? "0"),

};

}

}

Diese Daten speisen drei Zwecke: Billing (nutzungsbasierte Preisgestaltung), Kapazitaetsplanung (welche Tenants wachsen am schnellsten) und Debugging (liegt die langsame Erfahrung dieses Tenants an dessen Datenvolumen oder an einem Plattformproblem).

Richten Sie Dashboards mit Tenant-Level-Aufschluesselungen ein. Wenn ein Alert ausloest, sollten Sie innerhalb von Sekunden sehen koennen, ob es einen Tenant oder alle betrifft.

Alles zusammenfuegen

Eine produktionsreife Multi-Tenant-Architektur ist kein einzelnes Muster — es ist ein Stapel von Entscheidungen, die miteinander interagieren. Die Isolationsstrategie beeinflusst Ihr Verbindungsmanagement. Feature Flags beeinflussen das Billing. White-Labeling beeinflusst Ihre gesamte Frontend-Rendering-Pipeline. Benutzerdefinierte Integrationen beeinflussen Ihr Fehlerhandling und Monitoring.

Die Reihenfolge, die ich Teams empfehle, die das von Grund auf aufbauen:

- Beginnen Sie mit Shared-Everything und tenant-gescopten Queries. Finden Sie zuerst Ihren Product-Market Fit.

- Fuegen Sie Feature Flags und planbasiertes Gating hinzu, sobald Sie eine Preisseite haben.

- Bauen Sie die Integrationsregistry, wenn Ihr erster Enterprise-Kunde danach fragt.

- Implementieren Sie Schema-Isolation, wenn eine Compliance-Anforderung sie verlangt.

- Fuegen Sie White-Labeling hinzu, wenn ein Partner Ihre Plattform weiterverkaufen moechte.

- Bauen Sie die Migrations-Tools, wenn Sie einen Tenant zwischen Stufen verschieben muessen.

Jede Schicht baut auf der vorherigen auf. Die Middleware-Pipeline, das gescopte Query-Interface und die Integrationsregistry sind Fundamente, die alles darueber unterstuetzen. Wenn Sie die richtig machen, fuegen sich die fortgeschrittenen Muster ein.

Ich habe diese Muster ueber Restaurantplattformen, medizinisches SaaS und Projektmanagement-Tools hinweg gebaut. Die Domaenen sind unterschiedlich, aber die Multi-Tenancy-Herausforderungen sind bemerkenswert konsistent. Die Investition in ordentliche Tenant-Isolation, Konfiguration und Observability zahlt sich in dem Moment aus, in dem Sie Ihren ersten Enterprise-Kunden gewinnen, der fragt: "Wie sind meine Daten von Ihren anderen Kunden getrennt?"

Diese Frage ist ein Kaufsignal. Die Architektur, die Sie gebaut haben, ist die Antwort.

Danil Ulmashev

Full Stack Developer

Interesse an einer Zusammenarbeit?